Cambridge Sözlüğü, 2023 yılının kelimesini 'halüsinasyon' olarak belirledi. Sözlük, bu seçimin gerekçesini, yapay zekanın insan hayatlarına girişiyle beraber 'halüsinasyon' kelimesinin yeni bir anlam kazanması olarak açıkladı.

HALÜSİNASYONA YENİ TANIM

Yapay zeka ortaya çıkana kadar 'halüsinasyon' sözcüğü, olmayan şeyleri duymak ya da görmek, sanrılar yaşamak, halüsinasyon görmek gibi anlamlarla kullanılıyordu. Bu yıl ise kelimenin anlamları arasında yeni bir tanım eklendi. Bu yeni tanım "bir yapay zekanın yanlış bilgi üretmesi" şeklinde sözlükteki yerini aldı.

İNSANLAR ELEŞTİREL DÜŞÜNMELİ

Cambridge Sözlüğü'nün yayın müdürü Wendaly Nichols, sözlükte yapılan değişikliklerle ilgili açıklamasında, "Yapay zekanın 'halüsinasyon' görebilmesi gerçeği, insanların bu araçları kullanırken eleştirel düşünme becerilerini kullanmaları gerektiğini hatırlatıyor" dedi.

'HALÜSİLASYON GÖREN YAPAY ZEKA'

Yapay zeka alanında çalışmalar yapan Cambridge Üniversitesi'nden Dr. Henry Shevlin, normalde insan ürünü olan halüsinasyon artık gerçeklikten kopukluk yaşayan yapay zeka aracını ima eden bir fiil olduğunu ifade etti. Shevlin, "Zira halüsinasyon gören kullanıcı değil, yapay zeka" dedi.

OLMAYAN DAVALAR UYDURAN YAPAY ZEKAYA DİKKAT!

Geçtiğimiz günlerde dava dilekçesinde ChatGPT'yi kullanan bir avukat, sohbet robotunun var olmayan davalar uydurduğunu söyleyerek işinden atıldı. Analistler bu tarz sorunların önümüzdeki birkaç yıl daha devam edeceğini öngörüyor.

HALÜSİNASYON NEDİR?

Beyin, dışardan gelen uyarıcıları işleyerek veriye çevirmesiyle bilgi edinir. Bazı durumlarda ise beyin dışarıdan herhangi bir sinyal algılamadan; yani dokunma, tatma, koku alma ya da işitme gibi bilgileri edinmeden, kendiliğinden duyu alanlarını tetikler ve halüsinasyonlara neden olur. Halüsinasyonlar, kişinin sadece kendisinin duyabildiği, görebildiği, dokunabildiği ve koklayabildiği, gerçek olmayan duyuların algılanmasına verilen isimdir.

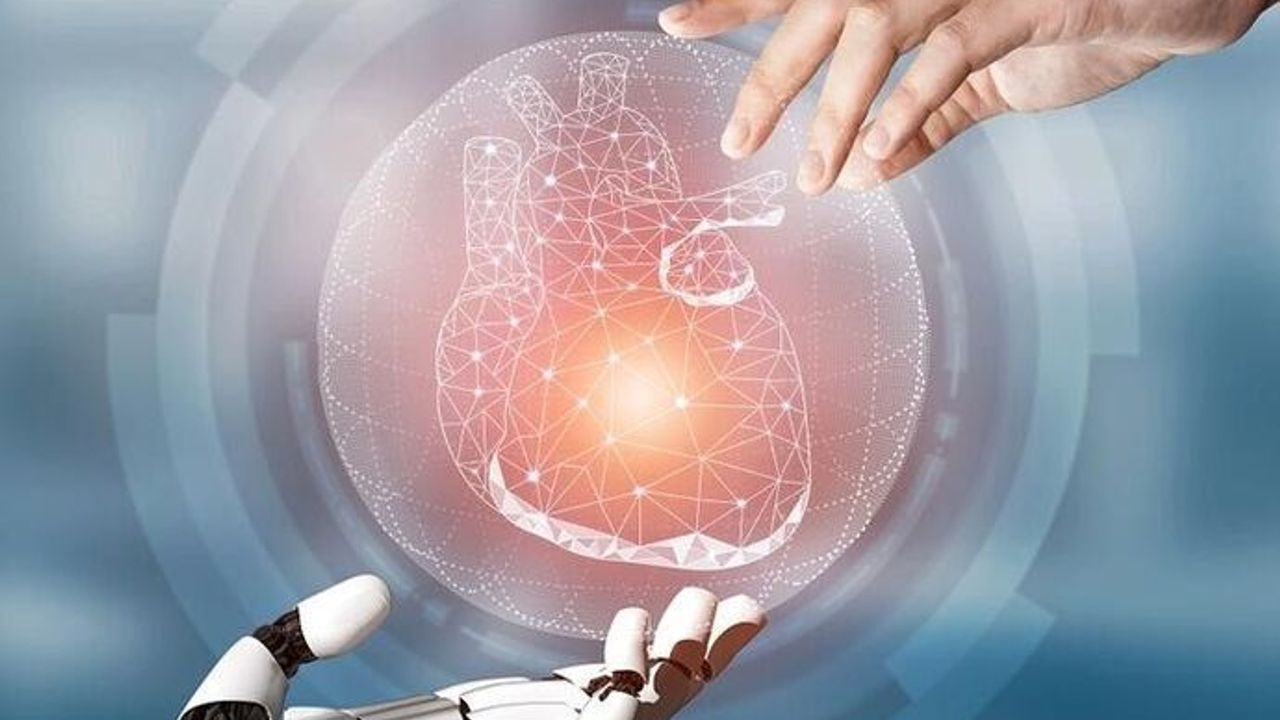

YAPAY ZEKA HALÜSİNASYONU NEDİR?

Üretken yapay zekânın, kaynağı olmayan bilgileri algılayıp gerçekmiş gibi kullanıcılara sunmasına ‘yapay zeka halüsinasyonu’ denir. Bu gerçek olmayan çıktılar, büyük dil modeli (Large Language Model=LLM) başlığı altına alabileceğimiz bir yapay zekâ sohbet robotu ChatGPT, Bard ya da çeşitli doğal dil işleme görevlerini yerine getirebilen yapay zekâ algoritmalarında karşımıza çıkabiliyor. Yapay zekâ halüsinasyonu, bir yapay zekâ modelinin, veri analizi, görüntü işleme gibi görevler sırasında gerçek dışı veya yanıltıcı sonuçlar üretmesini ifade ediyor. Bu olgu, modelin eğitildiği verilerin yetersiz ya da çelişkili olması, aşırı öğrenme (overfitting) veya modelin karmaşıklığından ortaya çıkabiliyor.

YAPAY ZEKA İNSANLAŞIYOR MU?

Bu kavram yapay zekânın insansılaştığı anlamına gelmese de halüsinasyon kavramı (hallucination/delusion) insana ait mental bir durumu yansıttığından, bu kelime yerine konfabülasyon (confabulation) teriminin kullanılmasının daha doğru olacağını belirtenler var.